Google-KI zu medizinischen Themen: Experimentell

Diagnosen von "Dr. Google" sind in Arztpraxen seit Jahren sprichwörtlich. Mit den nun in Deutschland ausgerollten KI-Ergebnissen Googles wird das Problem nicht kleiner.

Im Kleingedruckten unter den Antworten findet sich der Hinweis "Für eine medizinische Beratung oder Diagnose wende dich an eine medizinische Fachkraft. Generative KI ist experimentell." Dieser Hinweis trifft zu, im Gegensatz zu vielen KI-generierten Antworten, die Google auch bei medizinischen und gesundheitsbezogenen Fragen inzwischen ausgibt.

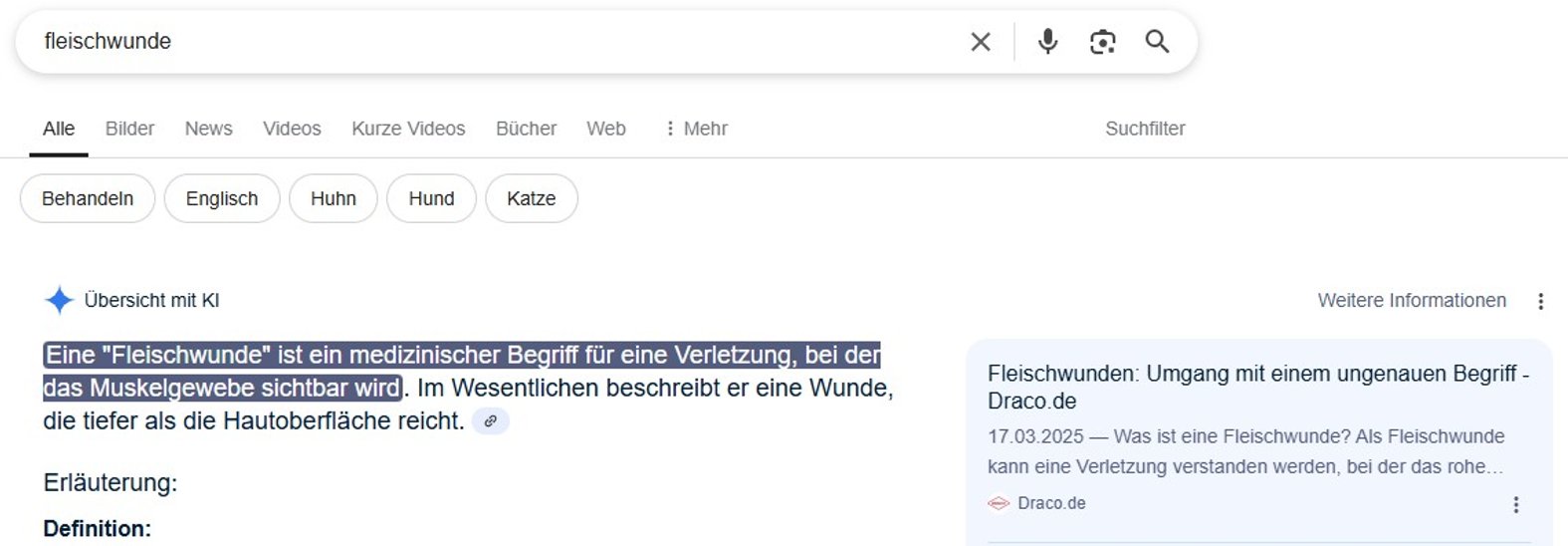

Google versucht sich dabei auch an der Definition angeblich medizinischer Begriffe. Die angegebene Quelle für die folgende Falschaussage – ein Draco.de-Artikel – weist direkt zum Einstieg explizit auf die Umgangssprachlichkeit des Begriffs “Fleischwunde” hin.

Zweiter und dritter Satz im Artikel lauten: „Für die Verwendung in medizinischen Fachkreisen ist der Begriff Fleischwunde jedoch zu ungenau und sollte vermieden werden. Dementsprechend existiert auch keine wissenschaftliche Definition dieses Begriffs.“ Sie werden von der KI komplett ignoriert.

Wenngleich im Notfall hoffentlich keine KI gefragt und die Versorgung eines Gamaschenulkus ohnehin von Fachpersonal vorgenommen wird, ist dennoch mit einer Zunahme der "Dr. Google"-Phänomene zu rechnen. Auch als Anbieter medizinischer Fachinformationen läuft man Gefahr, als Quelle faktischer Falschinformation in einem KI-Resultat angeführt zu werden.

In eigener Sache daher der Hinweis: auch bei der Nennung von Draco als Quelle in einer KI-Antwort sollte der angegebene Artikel gelesen werden. Für eine fachlich korrekte Wiedergabe der Inhalte durch Google kann keinerlei Sicherheit gegeben werden.

Das Problem ist nicht nur auf Google beschränkt. Eine Anfrage bei ChatGPT, warum Antworten der Google-KI bei medizinischen Themen problematisch sein könnten, wurde mit bemerkenswert anders falschen Aussagen beantwortet:

“Warum es problematisch ist: Alkohol und Wasserstoffperoxid können die Heilung einer Wunde verzögern, da sie auch gesunde Zellen schädigen. Eine schonendere Reinigung mit lauwarmem Wasser und mildem Seifenwasser ist in der Regel besser geeignet.”

Jenseits von Chat-KIs gibt es zahlreiche nützliche Anwendungsbereiche im medizinischen Bereich. Für den Sommer plant DRACO ein Expertengespräch zum Thema KI in der Wundversorgung, in dem konkrete Anwendungen, Chancen und Risiken besprochen werden.